Программирование – одна из областей, где ИИ используется очень широко. Большинство редакторов позволяют добавлять агентов искусственного интеллекта, таких как chatGPT, Copilot от Microsoft и т. д.

Также существует несколько открытых языковых моделей, специально ориентированных на кодирование, например CodeGemma.

И тут на сцену выходит новый игрок, о котором все говорят.

Этот новый игрок – OpenCoder, Code LLM с открытым исходным кодом, доступный в моделях 1 и 8B.

Поскольку OpenCoder набирает популярность, я решил быстро протестировать его в качестве локального AI-помощника, помогающего мне писать код в VS Code.

Опираясь на мой опыт, вы также сможете интегрировать OpenCoder (или любой другой LLM) в VS Code с помощью расширения CodeGPT и наслаждаться преимуществами локального AI-ассистента.

Это руководство выполнено на Ubuntu 24.04 в виртуальной машине. Указанные шаги в основном применимы на Ubuntu. Но вы можете повторить их и на других дистрибутивах Linux и операционных системах.

Шаг 1: Установите VS Code (если у вас его еще нет)

Сначала убедитесь, что Visual Studio Code установлена в вашей системе. Если нет, выполните следующие шаги, чтобы установить ее:

- Скачайте VS Code для Ubuntu здесь.

- После загрузки откройте терминал и установите его, запустив:

sudo dpkg -i ./<downloaded-file>.deb

После установки запустите VS Code из меню приложений или набравcodeв терминале.

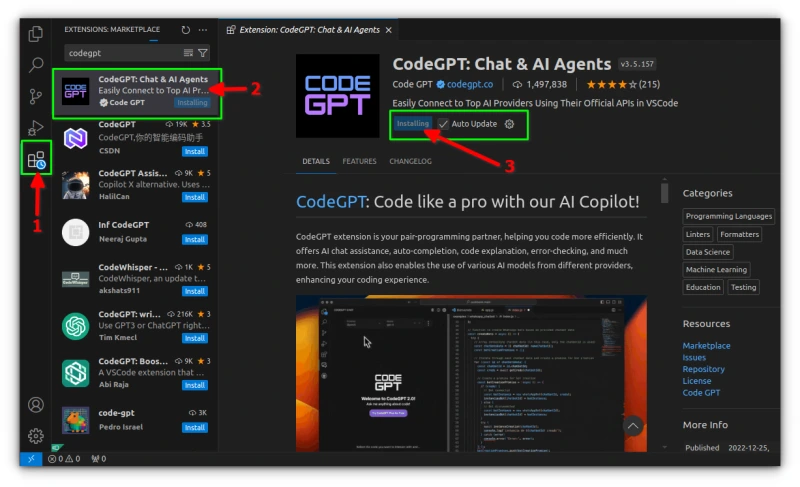

Шаг 2: Установите расширение CodeGPT

В то время как некоторые крупные платформы, такие как Ollama и LM Studio, можно интегрировать бесплатно, CodeGPT не совсем бесплатен. Базовое использование предоставляется бесплатно, но если вы ищете решение в один клик с расширенными возможностями, CodeGPT предлагает платные планы, требующие создания учетной записи. CodeGPT – это мощный инструмент, который я считаю бесценным для повышения производительности и упрощения рабочих процессов кодирования.

Являясь расширением для VS Code, он легко интегрируется, обеспечивая мгновенные предложения по коду, завершению и отладке именно там, где они мне нужны.

Вот как его установить:

- Откройте VS Code.

- Нажмите на значок расширений в боковой панели.

- Найдите CodeGPT в Маркете расширений.

- Выберите расширение и нажмите кнопку Установить.

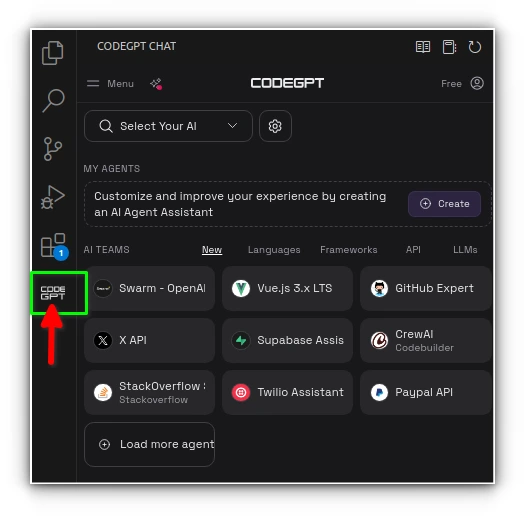

После установки расширение должно появиться в боковой панели для легкого доступа.

Это расширение служит интерфейсом между средой VS Code и OpenCoder, позволяя вам запрашивать предложения по коду, дополнения и многое другое.

Шаг 3: Установите Ollama

Ollama – это важный инструмент для управления и развертывания языковых моделей локально. Он упрощает процесс загрузки и запуска моделей локально, что делает его важнейшим компонентом для данной настройки.

Ollama предоставляет официальный сценарий установки. Выполните приведенную ниже команду, чтобы установить Ollama:

curl -fsSL https://ollama.com/install.sh | sh

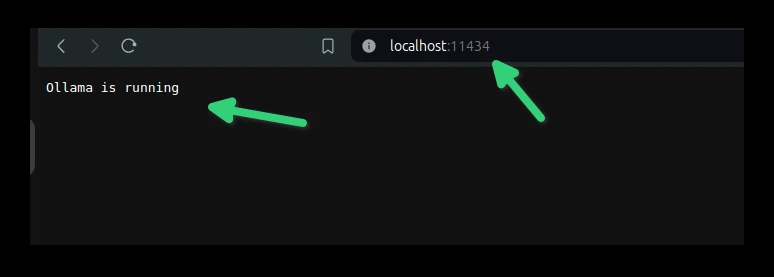

После завершения процесса установки откройте веб-браузер и введите:

localhost:11434

Должно появиться сообщение «Ollama запущена».

Мы также подробно описали шаги по установке Ollama, если вам это понадобится.

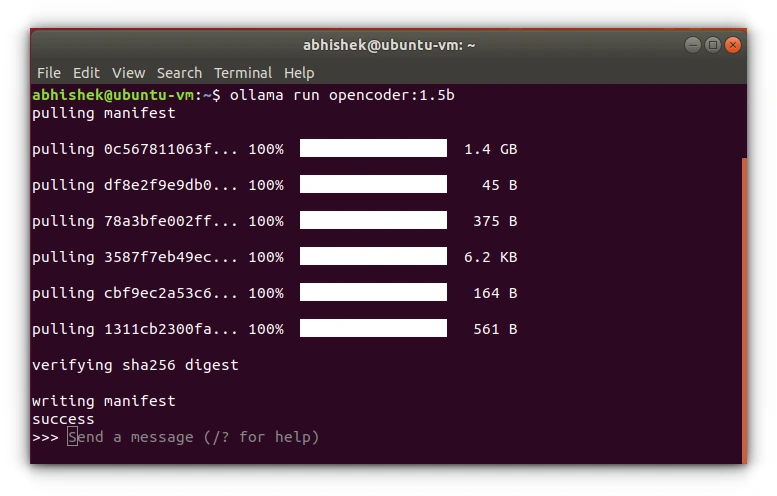

Шаг 4: Загрузите модель Opencoder с помощью Ollama

Установив CodeGPT и Ollama, вы готовы загрузить модель Opencoder:

В окне терминала введите:

ollama run opencoder

Это может занять несколько минут, в зависимости от скорости интернета и технических характеристик оборудования.

После завершения работы модель готова к использованию в CodeGPT.

Шаг 5: Запустите ИИ Copilot с помощью opencoder

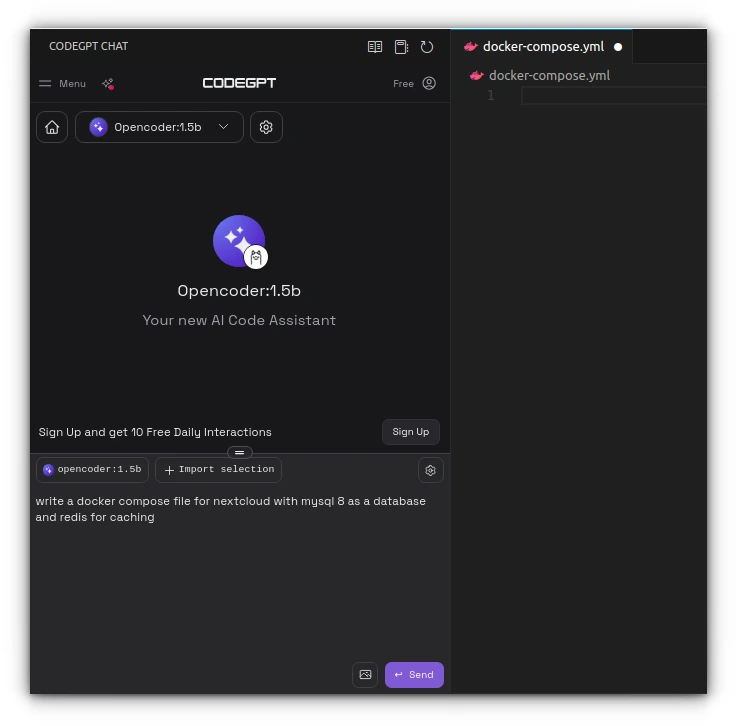

Откройте файл кода или проект в VS Code (я использую пустой файл docker-compose.yml).

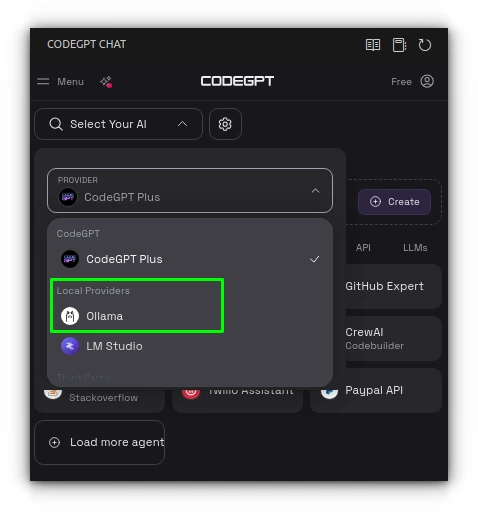

В панели CodeGPT убедитесь, что в качестве активного провайдера выбран Ollama.

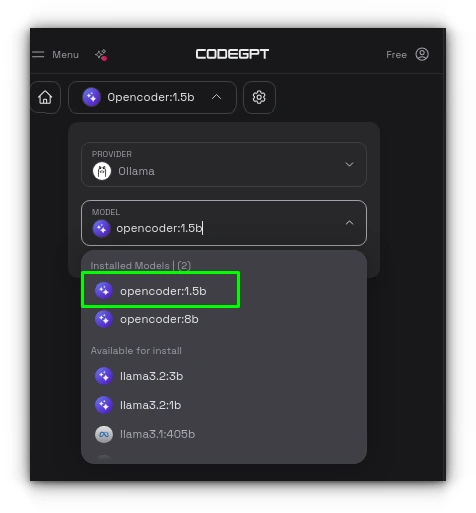

Далее вам будет предложено выбрать модель. Я скачал обе версии Opencoder с параметрами 1.5B & 8B, но я буду использовать первую:

Начните работать с моделью, вводя свои запросы, или используйте ее для завершения кода, получения предложений или любой необходимой вам помощи в кодировании:

Вот небольшое видео о том, как я взаимодействую с моделью OpenCoder внутри VS Code с помощью расширения CodeGPT.

Заключение

Протестировав OpenCoder с Ollama на своей виртуальной машине Ubuntu, я обнаружил, что, хотя производительность не такая высокая, как у облачных сервисов ИИ вроде ChatGPT, она вполне подходит для большинства задач кодирования.

Отзывчивость может варьироваться, особенно на скромном оборудовании, поэтому производительность немного субъективна и зависит от ваших настроек и ожиданий.

Тем не менее, если приоритетом является конфиденциальность данных и локальная обработка, то этот подход является хорошей альтернативой.

Для разработчиков, которые работают с конфиденциальным кодом и хотят иметь второго пилота ИИ, не полагаясь на облачные сервисы, Ollama и CodeGPT в VS Code – достойная настройка, балансирующая между конфиденциальностью и доступностью прямо на вашем рабочем столе.

Комментарии (0)